Na deepfake pornografii musíme reagovat. Měl by to být trestný čin, říká k návrhu náměstek ministra

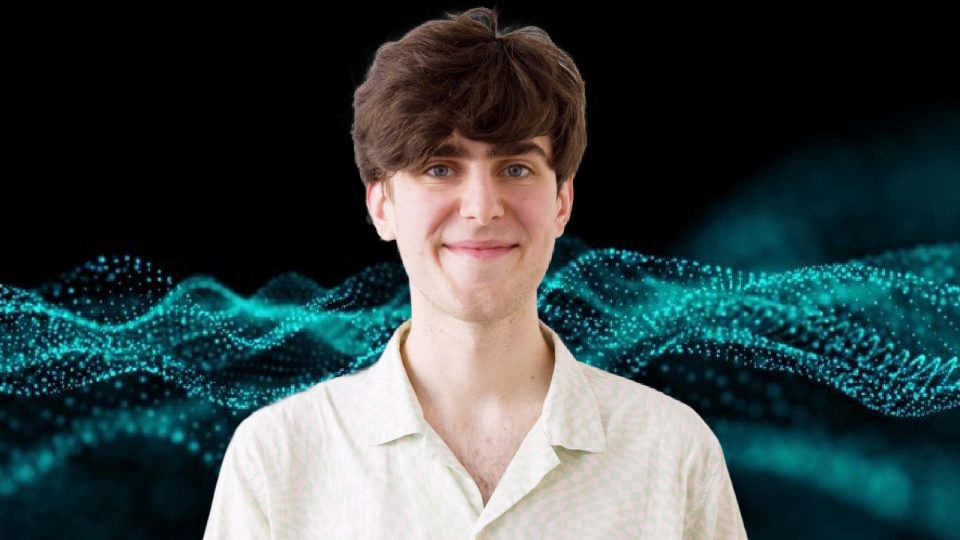

Videa nebo snímky vytvořené umělou inteligencí jsou k nerozeznání od pravých. A v tom je i velký problém. Ministerstvo spravedlnosti chce trestat vytváření pornografie pomocí umělé inteligence bez vědomí zobrazených lidí. Jde o takzvanou deepfake pornografii. Hrozit by za ni mohlo i vězení. „Je to trend, na který musíme reagovat, může dojít k velice závažnému zásahu do práv takto lživě zobrazených osob,“ objasňuje Karel Dvořák, náměstek ministra spravedlnosti z hnutí STAN.

Co přesně má být podle návrhu trestné?

Čtěte také

Navrhujeme vytvoření nového trestného činu, který se jmenuje zneužití identity k výrobě pornografie a její šíření. A tím postihovaným jednáním je výroba, distribuce, ale hlavně zveřejnění pornografických materiálů bez souhlasu zobrazované osoby, a to metodou, kdy nejde o reálný obraz, ale ten, který je vytvořený pomocí metody deepfake.

Když někdo pomocí umělé inteligence z oblečených fotek udělá nahé, to už bude trestné?

Ano, přesně tak. Toto jednání je bohužel potřeba nějakým způsobem postihnout nástrojem trestního práva, protože je to trend, na který musíme reagovat, může dojít k velice závažnému zásahu do práv takto lživě zobrazených osob.

Jak obtížné je hledání viníka? Podaří se takové skutky objasnit? Poslechněte si celý rozhovor.

Související

-

Urážky, fotomontáže, falešné profily. Jak své děti chránit před kyberšikanou?

Má vaše dítě mobilní telefon? A víte, co na něm dělá, jak na něm tráví čas? Neubližuje mu někdo? V dalším díle pořadu Antivirus probíráme téma kyberšikany.

-

Děti a pornografie? Rodiče musí vysvětlit, že vztah vypadá jinak, radí školní psycholožka

„S dětmi řeším běžné a domácí vztahy,“ říká školní psycholožka, která upozorňuje na to, že fenoménem dnešní doby je třeba online pornografie. Jak pracuje se šikanou?

-

Vědci vyzývají politiky k regulaci AI. „Naděje na úspěch je velice malá,“ myslí si Koubský

Ještě nedávno umělá inteligence stěží napočítala do desíti. Dnes vytváří realisticky vypadající obrázky, software, nebo dokonce řídí roboty. Je na místě její regulace?

Více z pořadu

E-shop Českého rozhlasu

Hurvínek? A od Nepila? Teda taťuldo, to zírám...

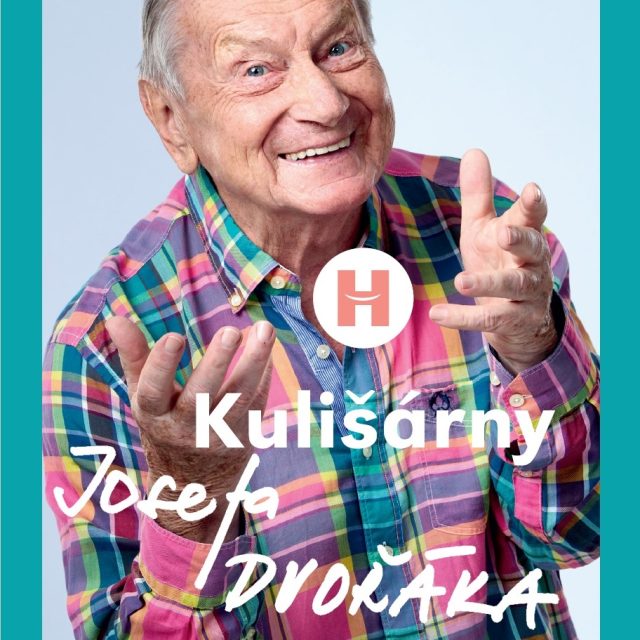

Jan Kovařík, moderátor Českého rozhlasu Dvojka

3 x Hurvínkovy příhody

„Raději malé uměníčko dobře, nežli velké špatně.“ Josef Skupa, zakladatel Divadla Spejbla a Hurvínka